Se è scritto in Python, è Machine Learning,

Se è scritto in Python, è Machine Learning,

se è scritto in Power Point è Intelligenza Artificiale.1

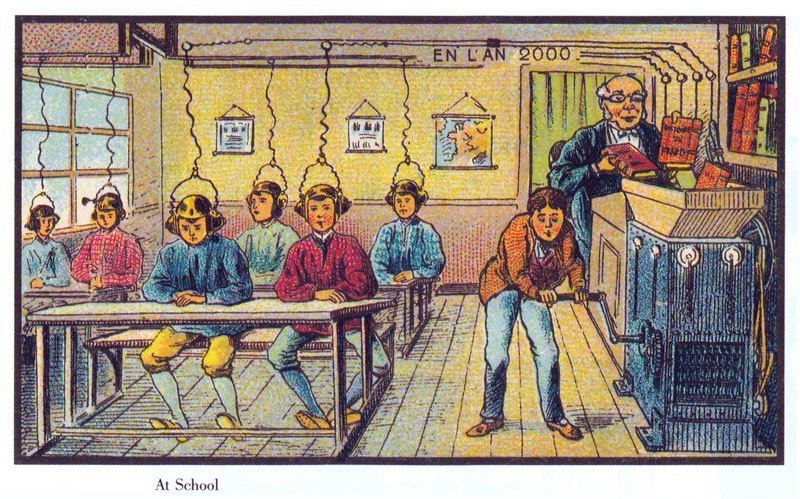

Tra le illustrazioni sulla vita dell’anno 2000 di Jean-Marc Côté, commissionate inizialmente per la World Exibition di Parigi del 1900 e poi regalate nelle confezioni di sigari e sigarette, ce n’è una sulla scuola: gli studenti sono collegati tramite cuffie a un dispositivo a manovella al quale l’insegnante dà in pasto i libri. Come le altre cartoline, anche questa è permeata da uno Zeitgeist caratteristico: la fanno da padrona un rampante positivismo, un’estetica da belle époque e l’idea, per fortuna oggi superata, di didattica come travaso di conoscenze dall’insegnante ai discenti; non c’è ovviamente traccia di intelligenza artificiale, ed è proprio per questo interessante, perché ci permette di vedere chiaramente, almeno nell’immaginario, qual è la misura del cambiamento quando le macchine iniziano a pensare, perché in quel momento iniziano davvero a fare qualcosa di nuovo: sostituiscono gli insegnanti umani.

Il 1951 è l’anno di inizio del sotto-genere fantascientifico “Intelligenze artificiali e didattica”: a questa data risale il racconto scritto da Isaac Asimov (che un decennio prima aveva inventato i cervelli positronici2 e usato per la prima volta il termine “robotica”) Chissà come si divertivano, in cui i bambini del futuro sono scolarizzati in casa da macchine; l’incrocio tra intelligenza artificiale e didattica rappresenta un punto di arrivo che anticipa di pochi anni la nascita, come espressione e come disciplina, dell’Intelligenza Artificiale (1956, convegno del Dartmouth College), e la prima famiglia di linguaggi di programmazione pensata per questo specifico ambito, il LISP (1958)3.

Nel 1995 Neal Stephenson scrive invece L’era del Diamante, o il sussidiario della giovinetta, un romanzo di fantascienza in cui un dispositivo, che a posteriori ricorda un iPad, è in grado di capire il mondo che circonda la sua proprietaria e di aiutarla a cavarsi d’impiccio, mentre la istruisce. Il sussidiario della giovinetta è un costrutto finzionale che “vede” il contesto della sua discente e lo connette alla sua funzione educativa: il modello didattico soggiacente è significativamente più raffinato di quello del calcolatore di Asimov, ma è interessante anche perché l’ultimo grido in fatto di intelligenza artificiale, il Deep Learning, muove i primi passi proprio dalla visione artificiale e da sistemi di calcolo parallelo sviluppati per i processori grafici.

Questa immagine dell’IA che si sostituisce ai docenti in carne ed ossa è la prima critica che fu levata nel 2011 quando lanciammo, prima come sperimentazione con il patrocinio dell’INDIRE e della Fondazione Agnelli poi come prodotto commerciale, un software per la didattica della traduzione dal latino. Cicero “recitava” una sceneggiatura in cui poneva domande e si aspettava risposte dall’utente: il suo scopo era quello di indurre, con l’iterazione di task semplici, l’acquisizione di buone pratiche traduttive4.

L’intelligenza di Cicero era nascosta dove pochi l’avrebbero cercata, per esempio eseguiva uno stemming5 delle parole nel testo italiano di destinazione, quindi distingueva errori di traduzione — nei morfemi lessicali — ed errori grammaticali — nei morfemi flessionali. Anche se questo comportamento era il frutto di una progettazione intelligente, non applicava nessun algoritmo o tecnica di intelligenza artificiale e non basava la sua valutazione su grandi quantità di dati: si trattava di azioni regolate da una serie di espressioni regolari e funzioni che venivano applicate linearmente. O ancora, sulla base delle risposte dosava l’informazione nelle domande successive sullo stesso argomento6, ma anche in questo caso il suo comportamento era guidato da istruzioni rigide e immodificabili.

Dov’era allora la sua intelligenza? Chiedeva conferma al docente delle sue valutazioni e, se veniva rilevato un suo errore da almeno tre docenti, estendeva a tutti la nuova valutazione (altrimenti la applicava solo a tutti gli e le studenti del docente che aveva emendato il suo comportamento)7. Senza ricorrere a reti neurali, si trattava comunque di un rudimentale sistema di supervised (grazie al contributo dei docenti) learning.

Nonostante la sua intelligenza nascosta, doveva tuttavia avere qualcosa di inquietante: forse perché interagiva più o meno dialogicamente con gli e le studenti (ma senza nessun artificio per passare il test di Turing: ci eravamo limitati a scrivere in maniera più friendly istruzioni tipo «isola il periodo» e «trova tutti i predicati presenti»… niente di raffinato come uno dei chatbot che si stanno affacciando sul panorama dell’edtech di oggi), diversi docenti non vi si avvicinarono neppure, inorriditi dall’idea che si potesse pensare di sostituirli con un’algida, limitata macchina.

A cosa pensano i tecnici quando parlano di IA

L’intelligenza artificiale è un’idea affascinante o temibile, indefinibile e inafferrabile, almeno finché non ci si sporca un po’ le mani per realizzarla, allora magari rimane ancora inafferabile, ma certo diventa meno indefinita.

Creare intelligenze artificiali significa sostanzialmente programmare (il linguaggio che va per la maggiore in questo settore oggi si chiama Python8), cioè scrivere sequenze di istruzioni.

Grosso modo dagli anni Ottanta del secolo scorso la locuzione intelligenza artificiale, negli ambienti in cui non poteva riferirsi a un’idea troppo mutevole, è stata gradualmente sostituita da Machine Learning: il Machine Learning (d’ora in poi ML) è una raccolta di algoritmi e tecniche per progettare sistemi che possano imparare dai dati usati per il training e che di conseguenza siano in grado di elaborare predizioni o individuare pattern in altri dati9.

La prima caratteristica del ML è quindi la ricerca di pattern all’interno di grandi quantità di dati.

Se al sistema di ML è stato detto che cosa cercare è Supervised Learning, altrimenti, a seconda che stia cercando di raggiungere un obiettivo attraverso prove ed errori oppure no, si tratta di Reinforcement Learning oppure Unsupervised Learning.

In tutti questi casi, il sistema potrebbe appoggiarsi a una rete neurale artificiale, in tal caso si chiamerà Deep Learning, che è l’astro emergente delle IA dallo scorso decennio.

Per semplificare le cose, si può aggiungere che una rete neurale artificiale è una rete di unità di elaborazione distinte in nodi di input, che ricevono gli stimoli, nodi nascosti, di solito organizzati in strati che comunicano l’uno con l’altro, e nodi di output. La rete neurale è un sistema adattivo che cambia la propria struttura in base alle informazioni che scorrono attraverso la rete stessa durante la fase di training.

A cosa pensiamo quando parliamo di IA e insegnamento

Ancora oggi, quando parliamo di applicazioni di IA alla didattica, il pensiero va naturalmente alla vulgata che ci ha fornito la fantascienza, ignorando che oggi l’intelligenza artificiale è sostanzialmente il Machine Learning – il quale, come dice il nome è appunto learning, e non teaching.

Le macchine possono quindi imparare, il che non le mette necessariamente in grado di insegnare. A patto di definire che cos’è l’insegnamento, perché del complesso sistemico delle attività didattiche sono state già, almeno in parte, subappaltate alle macchine:

- la preparazione e la messa a disposizione di materiali formativi e sommativi;

- la pianificazione;

- la registrazione dei voti e delle assenze;

- la comunicazione con docenti e colleghi. (Ognuno farà la stima di quali dispositivi software usa per compiere queste azioni e altre che qui non menzioniamo).

Se le macchine raccolgono, analizzano e confrontano i dati in maniera più efficace ed efficiente degli esseri umani, quali possono essere i contributi del ML alla didattica? La domanda è tanto più ficcante dopo l’emergenza sanitaria che ha sparigliato pratiche didattiche abitudinarie (senza connotazioni di sorta) e costretto docenti e studenti a parlarsi per mezzo di schermi.

ML e studenti

Il campo di applicazione di alcuni software è focalizzato sul rapporto con lo o la studente.

Le analisi predittive sono alla base dei progetti che mirano a personalizzare l’erogazione dei contenuti: l’Intelligent Tutoring System di Pearson prova a erogare il miglior contenuto per ogni studente (funziona bene per cose basiche e propedeutiche); il progetto della repubblica del Niger per la formazione degli insegnanti UTIFEN sulla base dei bisogni e dei progressi degli utenti può aggiungere o togliere contenuti.

I prodotti della finlandese Sanalabs analizzano i risultati dei discenti e suggeriscono loro percorsi di studio personalizzati.

Il software Edsight interagisce via chatbot con gli e le studenti riguardo alla loro “vita scolastica”, analizza i loro comportamenti e aiuta a non abbandonare gli studi suggerendo azioni specifiche per ogni individuo. Questo tipo di intervento potrebbe diventare essenziale, in un panorama che preveda periodiche chiusure degli spazi scolastici e delle pratiche che vi sono associate (le quali rappresentano con la loro stessa presenza un freno alla dispersione), anche se vale la pena di annotare due cose:

- per individuare buona parte della dispersione a cui docenti di tutta la nazione hanno assistito probabilmente non è necessario il ML: basta la conoscenza che hanno i docenti dei loro studenti e soprattutto delle loro famiglie;

- quando i motivi dell’abbandono dipendono da pratiche individuali sui quali il singolo studente minorenne non ha pieno controllo (a titolo esemplificativo e non esaustivo: in una situazione di lockdown in famiglia non c’è disponibilità di dispositivi adeguati, di accesso di banda, di competenze specifiche dei genitori), un software come questo è semplicemente inutile.

Studenti, ML e docenti

Altre applicazioni raccolgono dagli e dalle studenti i dati (risultati, tempi d’uso, ordine delle lessìe consultate), li analizzano e poi li inviano ai docenti: è quello che fanno Happy Numbers con la matematica per la primaria e Century, che in più suggerisce ai docenti dei percorsi di studio personalizzati per gli studenti.

Al di là dell’ambito dell’automated grading, il chatbot Hubert.ai (che ha anche applicazioni nel settore della sondaggistica) è progettato per interagire con gli studenti, raccogliere feedback su lezioni e corsi e valutarli.

Lexplore, un complesso di software e hardware, analizza il movimento delle pupille nel corso della lettura per riconoscere DSA e permettere ai docenti interventi mirati.

Forse, questa è una riflessione suggerita dalla quarantena, potrebbe valere la pena di iniziare a considerare il ruolo di docenza di cui si sono dovute far carico le famiglie (quelle che hanno potuto) e si potrebbe iniziare a pensare un qualche strumento che metta in relazione l’attività di docenza portata avanti sui due fronti: familiare e scolastico.

ML e docenti

Il più comune strumento che utilizza il ML usato dai docenti non ha nulla a che fare con la didattica (e non è usato solo dai docenti): i motori che dato un video/prodotto te ne consigliano un altro, e quelli che somministrano pubblicità, ricorrono ad algoritmi intelligenti (ambito delle recommendation of resources: utile tuttavia quando un docente cerca risorse online per le proprie spiegazioni).

Ma non mancano progetti più orientati alla didattica in senso stretto: Parallel Education confronta prove parallele e suggerisce, sulla base delle informazioni date dai docenti stessi, le pratiche di insegnamento più efficaci rilevate sullo stesso argomento in classi comparabili.

ML e… software?

Nel 2014, anche complice la prepotente diffusione degli smartphone e dei mobile games10, decidemmo di fare quello che in un certo lessico aziendale si dice pivotare: invece di indirizzarci agli editori di scolastica come unici clienti provammo a rivolgerci direttamente agli utenti finali, docenti e discenti, per un prodotto che “parlasse” la lingua dei dispositivi mobili. Alatin applica una diversa declinazione di adattività rispetto a Cicero: invece di riproporre il medesimo quesito cambiandone la formulazione e la quantità di informazione/supporto, aumenta il numero di quesiti. Questa trasformazione era indotta da due vincoli del canale:

- riduzione dello spazio (riprogettare i contenuti in modo che non ponessero problemi di ergonomia sui piccoli schermi dei dispositivi mobili);

- riduzione del tempo (atomizzare i contenuti e i task associati a ogni contenuto atomico per garantire pacing e massimizzazione del carico cognitivo rilevante a danno, semplificando, del carico cognitivo estraneo e di quello intrinseco).

Ma certo riprogettare contenuti non ha nulla a che fare, per sé e per ora, con l’intelligenza artificiale. La prima occasione di confronto con il ML ci si è presentata mentre cercavamo di capire come fronteggiare il problema delle varianti nelle traduzioni libere: in tutti i task nei quali era richiesto ai e alle discenti di scrivere una traduzione libera avevamo affrontato la questione con il corrispettivo informatico dell’uso della forza bruta: un gran numero di traducenti possibili.

Per chiarire, una proposizione come «Non supplicium deprecarer», conta nel nostro database 655 traducenti, che vanno da «non scongiurerei il supplizio» a «non pregherei che egli venisse sottratto al castigo» passando per tutti i sinonimi anche multilessicali di scongiurare e supplizio e per le variazioni sintattiche e semantiche (articoli determinativi vs. indeterminativi, preposizioni articolate vs. semplici). Il tutto senza la garanzia di aver trovato ogni possibile variante.

Abbiamo quindi iniziato a ragionare sulla possibilità di un software in grado di distinguere autonomamente gli errori dai falsi negativi, che quindi agisse non in diretta relazione con utenti umani, ma con altri software (anche se ovviamente la valutazione delle risposte ha un effetto sull’esperienza utente).

Poi ci siamo resi conto che classificare i tipi di Errori/Variazioni, o almeno distinguerli in Errori/Variazioni di tipo ortografico e sintattico avrebbe reso più efficace il sistema.

Poi abbiamo dovuto fronteggiare il problema di avere un numero relativamente piccolo di testi ideali per il training della ML (che sono tanto più efficaci quanto più ricco e meglio costruito è il corpus di addestramento).

Poi abbiamo iniziato a discutere di come gestire nell’interazione umano-macchina quel 15% di casi che si sottraevano alla capacità del sistema di individuare una compitazione apparentemente sbagliata (avevamo deciso di concentrarci sugli errori ortografici per iniziare) perché qualsiasi strumento didattico deve prevedere un certo grado di trasparenza rispetto all’utente finale.

Conclusione, anzi, no

Alatin e la famiglia di prodotti collegati (Itaca, Lyceum, Alex) si stanno affacciando all’universo del Machine Learning; abbiamo iniziato a lavorarci e fare esperimenti, ma realizzare l’idea di un software che sia in grado di decidere se una particolare forma è il frutto di un errore di digitazione o meno è un lavoro che richiede la costruzione di un training corpus significativo, la scelta degli algoritmi più promettenti, un certo numero di prove, tentativi, test, riscritture.

Navigando nel sito paperswithcode.com, che non è l’unico riferimento per il ML al mondo ma un buon punto di riferimento, è possibile valutare vari ambiti di applicazione dell’intelligenza artificiale, considerare quali linguaggi di programmazione, tecniche e raccolte di algoritmi sono più efficaci per i vari ambiti presi in esame e, in definitiva, rendersi conto di quanto questa disciplina sia ancora in evoluzione e lontana dalla human-like intelligence propagandata dalla fantascienza.

Se è vero che le macchine raccolgono, analizzano e confrontano i dati in maniera più efficace ed efficiente degli esseri umani, gli esseri umani capiscono gli altri esseri umani (o dovrebbero farlo) e il rapporto che intercorre tra docenti e studenti è quella parte dell’esperienza di apprendimento che difficilmente potrà essere sostituita, per quanto sia abile la macchina a imparare.

NOTE

- Questo esergo dovrebbe forse stare in coda, perché se non è chiaro adesso lo diventerà dopo la lettura del testo. Per ora basterà annotare che si tratta di una battuta che circola in ambito informatico e che suona un po’ come: «Se lo sa, è il tuo ragazzo; se non lo sa, è una dolce fantasia».

- La più famosa, se non la prima, descrizione in termini moderni di intelligenza artificiale nella narrativa.

- Mentre è del 1950 il celebre articolo di Alan Turing Computer Machinery and Intelligence.

- Una commistione originale tra il caro vecchio drill and practice e l’authentic assessment di scuola canadese.

- Distinzione della radice e della flessione delle parole non grammaticali. Nel caso specifico mettemmo nella radice anche i morfemi derivazionali.

- Una delle possibili declinazioni del concetto di adattività del software nell’interazione umano-macchina.

- Questo è un sistema in grado di apprendere e riapplicare quanto appreso, consulta grandi quantità.

- Inventato nel 1991 dal programmatore tedesco Guido van Rossum e chiamato così in onore dei Monty Python.

- Il che, a ben pensarci, è esattamente il primo grado di apprendimento: applicare altrove quello che si è imparato. Imparare a imparare nuove cose e imparare a decidere che cosa imparare è più complicato e per ora rientra, insieme alla human-like intelligence, nel dominio della fantascienza.

- I videogiochi progettati per smartphone hanno caratteristiche specifiche.