Le iniziative degli ultimi mesi che vedono coinvolte scuola e università – ma anche il dibattito generalista sull’argomento – hanno in comune un’evidenza: è urgente prendersi cura della discussione sulla cosiddetta “intelligenza artificiale”, in particolare di quella generativa.

Il “cosiddetta” è d’obbligo, e andrebbero infatti assolutamente evitate ogni esaltata sovrapposizione e ogni temuta coincidenza con processi cognitivi umani: siamo di fronte a macchine statistico-predittive, che, sulla base di presupposti matematici incapsulati negli algoritmi, ne imitano gli esiti, anche in termini di decisione, ma non certo le modalità di funzionamento e sviluppo. L’insistenza sul termine “intelligenza” come elemento esplicativo, per altro, testimonia da una parte l’efficacia del marketing (pluridecennale) e dall’altra la diffusa incapacità di costruire un lessico davvero in grado di rendere comprensibili funzionamento e finalità degli applicativi. Per troppi, inoltre, l’intelligenza artificiale – da tempo presente e riconosciuta come tale dagli addetti ai lavori in motori di ricerca, assistenti per smartphone, consigli pubblicitari, servizi di trasporto e così via – si riduce a ChatGPT.

Conseguentemente, va rifiutata con determinazione ogni iniziativa di occupazione – spesso lobbistica – dello spazio di confronto pubblico, destinato invece a una discussione delicata, che avrebbe bisogno di problematizzazione e non di premature certezze volte a creare filiere di formazione e a ribadire il potere epistemologico e la capacità auto-promozionale delle reti accademiche e dei soggetti istituzionali analoghi nel mondo dell’istruzione.

Analogamente, vanno allargati con lucidità il punto di vista sui dispositivi considerati e la valutazione delle loro implicazioni operative, professionali e culturali.

Innanzitutto, chiarisco che siamo di fronte a oligopoli, perché solo le grandi corporation internazionali dispongono della potenza di calcolo, dell’infrastruttura e dell’accesso ai dati necessari per l’innesco dei processi di individuazione di regolarità, pattern, correlazioni e configurazioni utili per fornire risposte alle richieste degli utenti (clienti). E deve essere chiaro che limitarsi ad acquisire e a far acquisire competenze adattive, di manovra, significa operare una scelta politica, l’accettazione del modello socio-economico e culturale attuale come unico possibile, e di conseguenza di ciò che si prospetta come unico futuro possibile. Non è casuale, del resto, il quasi ossessivo riferimento al totemico mercato del lavoro presente in molti documenti e linee guida.

Va considerato con grande attenzione che questa visione si colloca nel campo del produttivismo, perché assume con indifferenza che l’estrazione dei dati possa moltiplicarsi all’infinito, nonostante i rischi di lesione di riservatezza e autorialità; e anche dell’ambiente, con i consumi, le emissioni, gli sfruttamenti di risorse e la produzione di rifiuti elettronici dall’operatività concreta e dalla materialità dei dispositivi digitali[1].

Il poco interesse per questioni che sono invece centrali è probabilmente conseguenza dell’idea che esse riguardino altri campi e altri luoghi decisionali. Le istituzioni dell’istruzione scelgono di auto-confinarsi in un perimetro predefinito, retoricamente depurato da qualsiasi attrito e qualunque conflitto socio-economico ed ecologico, assumendo come postulato la conciliabilità delle esigenze economiche con quelle etiche.

A neutralizzare e naturalizzare i dispositivi, del resto, ben si presta l’impiego così ossessivo da apparire auto-assolutorio del termine “strumento” (a volte anglicizzato in “tool”). Ridurre l’IA e gli apparati digitali allo loro “strumentalità” (ovvero a scopi dichiarati e funzionamento) permette di soprassedere sul fatto che, invece, essi determinano condizioni, situazioni, regole di ingaggio, realizzano feedback retroattivi, inducono a comportamenti e così via, contribuendo con la propria complementarità attiva a modificare profondamente i contesti e le relazioni.

A integrare questa scelta lessicale con valenza ontologica troviamo l’abuso della parola “creare” e dei suoi derivati. Del resto, questo vezzo linguistico, che sottace il valore di progettazione ed elaborazione, inquina da tempo l’intera produzione di materiali didattici da parte di molti docenti. Riferita all’intelligenza artificiale generativa, la presunta “creatività” giustifica ulteriormente la validazione dell’estrattivismo, della privatizzazione della conoscenza pubblica, che diventa contenuto, da intendersi come investimento, risorsa economica, nell’ambito della mercificazione generale (commodification) della conoscenza – e dell’istruzione. Concepire invece una ripartenza “da zero” di processi di produzione culturale originale invisibilizza l’appropriazione e la cattura della cooperazione e della conoscenza sociale da parte dei meccanismi capitalisti.

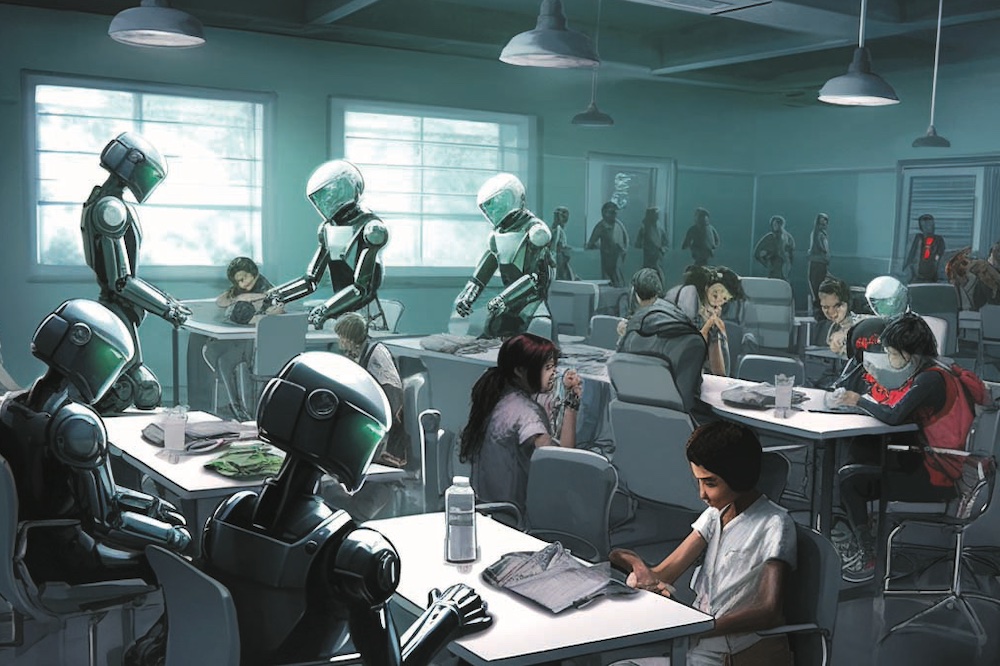

Andrebbe avviata una riflessione davvero approfondita sui dispositivi di IA che hanno compiti più specifici rispetto ai chatbot “generalisti”. Mi riferisco in particolare ai moduli in cui viene articolata l’attività dei docenti dai portali di accesso a risorse differenziate[2]. Questi insiemi propongono sia una sorta di precettori artificiali di supporto all’apprendimento o alla redazione di contenuti, sia batterie di facilitatori delle attività esecutive e ripetitive, ad esempio la realizzazione di questionari o di altre prove strutturate, ma anche la riscrittura di un testo affinché sia più accessibile. La scelta di fondo di questi ambienti, che stanno proliferando sul mercato dell’istruzione, è infatti mettere gli utenti nella condizione di affrontare in modo assistito e fortemente guidato le problematiche relative a definizione degli obiettivi, istruzioni, prime richieste, prosecuzione delle conversazioni e così via. Questo approccio configura prospettive ben diverse dal “prompt engineering” o dalla “didattica conversazionale”, metodi e modalità a cui attualmente sono assegnati invece uno spazio eccessivo, probabilmente anacronistico.

Non vi è, infine, alcuna vera attenzione al problema delle licenze d’uso. La gran parte dei dispositivi offre versioni di prova o a funzionamento parziale o limitato nel tempo, per poi indirizzare verso abbonamenti e altre soluzioni analoghe. Poiché sarebbe iniquo far ricadere questi costi su personale scolastico e famiglie, questo fattore dovrebbe entrare nella discussione.

Insomma: non è certo il momento di banalizzare le riflessioni e di trivializzare le scelte. C’è invece ancora molto da capire, molto da provare, moltissimo da discutere: nessun rifiuto aprioristico, ma nemmeno superficialità e inerzia.

Note

[1] Cfr. G. Sissa, Le emissioni segrete. L’impatto ambientale dell’universo digitale, il Mulino, Bologna 2024.

[2] Ad esempio, maestragenia.it, magicschool.ai, diffit.me, poe.com. e, in parte, le risorse raccolte in https://chatgpt.com/gpts. Vanno per altro considerati e vagliati anche dispositivi come Google One AI Premium, Microsoft Copilot Pro o il recentissimo Google NotebookLM, che offrono funzionalità molto oltre la semplice conversazione.